深度学习资料.

https://medium.com/pyladies-taiwan/%E6%B7%B1%E5%BA%A6%E5%AD%B8%E7%BF%92%E6%96%B0%E6%89%8B%E6%9D%91-pytorch%E5%85%A5%E9%96%80-511df3c1c025

http://pytorch.org/tutorials/beginner/deep_learning_60min_blitz.html

深度学习与PyTorch:60分钟的闪电战

本教程的目标:

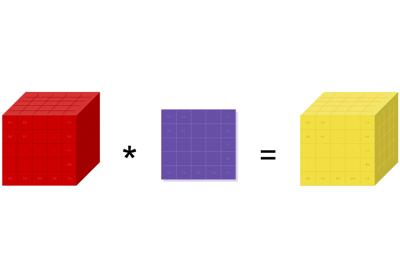

- 高度理解PyTorch的张量库和神经网络。

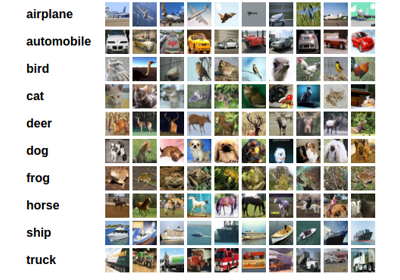

- 训练一个小型神经网络来分类图像

本教程假设您对numpy有基本的了解

注意

确保安装了割炬和torchvision软件包。

https://morvanzhou.github.io/tutorials/machine-learning/torch/

-

PyTorch 简介

-

PyTorch 神经网络基础

-

建造第一个神经网络

-

高级神经网络结构

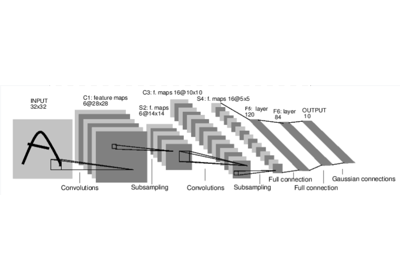

- 4.1 什么是卷积神经网络 CNN (Convolutional Neural Network)

- 4.2 CNN 卷积神经网络

- 4.3 什么是循环神经网络 RNN (Recurrent Neural Network)

- 4.4 什么是 LSTM 循环神经网络

- 4.5 RNN 循环神经网络 (分类)

- 4.6 RNN 循环神经网络 (回归)

- 4.7 什么是自编码 (Autoencoder)

- 4.8 AutoEncoder (自编码/非监督学习)

- 4.9 什么是 DQN

- 4.10 DQN 强化学习

- 4.11 什么是生成对抗网络 (GAN)

- 4.12 GAN (Generative Adversarial Nets 生成对抗网络)

-

高阶内容

----------------------------

-

Tensorflow 简介

-

Tensorflow 基础构架

-

建造我们第一个神经网络

-

可视化好助手 Tensorboard

-

高阶内容

- 5.1 Classification 分类学习

- 5.2 什么是过拟合 (Overfitting)

- 5.3 Dropout 解决 overfitting

- 5.4 什么是卷积神经网络 CNN (Convolutional Neural Network)

- 5.5 CNN 卷积神经网络 1

- 5.6 CNN 卷积神经网络 2

- 5.7 CNN 卷积神经网络 3

- 5.8 Saver 保存读取

- 5.9 什么是循环神经网络 RNN (Recurrent Neural Network)

- 5.10 什么是 LSTM 循环神经网络

- 5.11 RNN 循环神经网络

- 5.12 RNN LSTM 循环神经网络 (分类例子)

- 5.13 RNN LSTM (回归例子)

- 5.14 RNN LSTM (回归例子可视化)

- 5.15 什么是自编码 (Autoencoder)

- 5.16 自编码 Autoencoder (非监督学习)

- 5.17 scope 命名方法

- 5.18 什么是批标准化 (Batch Normalization)

- 5.19 Batch Normalization 批标准化

- 5.20 Tensorflow 2017 更新

- 5.21 用 Tensorflow 可视化梯度下降

- 5.22 什么是迁移学习 Transfer Learning

- 5.23 迁移学习 Transfer Learning

x -----------------------------

Theano 简介

-

Theano 基础构架

-

搭建自己的神经网络

-

总结

-

- 上一篇 Tensorflow object detection.

- 下一篇 墙 墙 墙 墙.